最近,GitHub Copilot 又“整活儿”了。

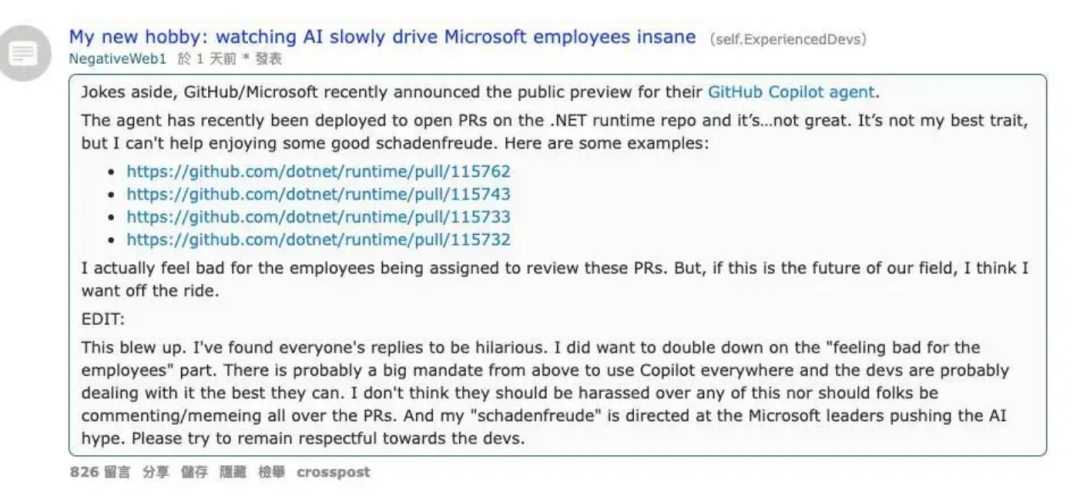

Reddit 上一位网友发帖调侃:“我最近迷上了一个新爱好:看 AI 一点点把微软员工逼疯。”

这不是段子,而是对微软 .NET 仓库里一连串尴尬 PR(Pull Request,拉取请求)的讽刺。这些 PR 居然都是由微软推出的 AI 编程助手 Copilot Agent 自动提交的。

图片

图片

发帖者表示,Copilot 的表现“差到让人上头”,甚至坦言自己对现场事故感到“罪恶的快乐”——他为那些被迫审核这些 PR 的微软工程师感到同情,同时怀疑是不是管理层强推 Copilot 上线,工程师们只能硬着头皮接招。

不过,他的“幸灾乐祸”并不是针对一线员工,而是冲着那些高喊 AI 万能、却对其局限一无所知的领导层去的。

令人意外的是,这条帖子很快爆红,成了程序员圈的讨论焦点,也间接引爆了一场更深层的争议:AI 编码工具到底是生产力神器,还是只会添乱的“熊孩子”?

1.Copilot Agent 一上线,就翻车?

本周,微软正式上线了 GitHub Copilot Agent 公测版本。官方介绍说,这是一个基于大语言模型的智能助手,能够胜任中低复杂度的开发任务,比如新增功能、修 Bug、扩充测试、优化文档,甚至可以自动提交代码 PR。

从公开记录看,微软确实在尝试将 Copilot Agent 深度嵌入 .NET 仓库,专门处理一些系统级的小修小补,比如正则表达式逻辑修复、跨平台兼容处理、文档重构等。

用官方话来说:把 AI 拉上“前线”,试试看能不能顶上。这看起来像是一场关于 AI 编程边界的实验——但实验结果显然“翻车”了。

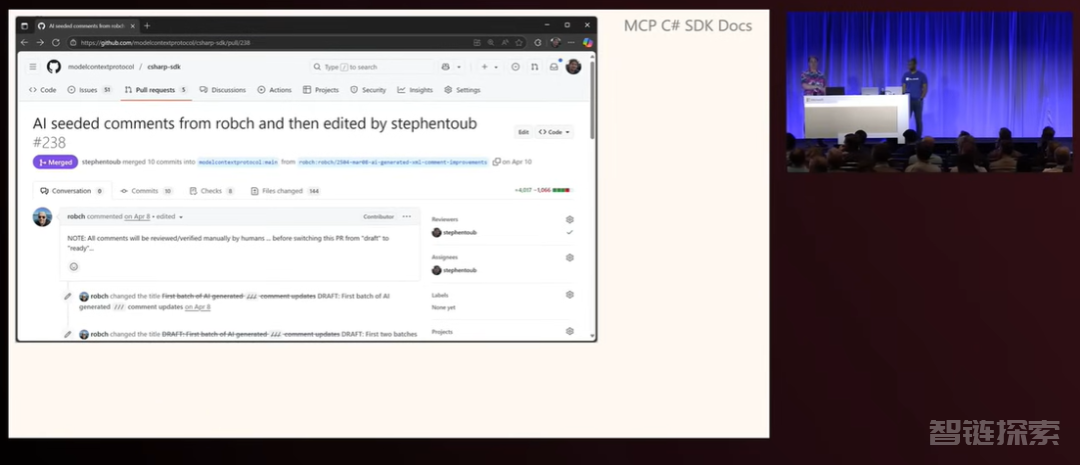

更巧的是,就在两天前的某开发者大会上,一位微软 .NET 工程师还在台上信誓旦旦地表示:Copilot 已经成了他们日常工作流的一部分。

演讲中,他详细讲解了 AI 在更新正则引擎、协助编程、修复 bug、增强模块内存等方面的作用,强调 AI 不再只是炒作,而是真正的生产力工具。

图片

图片

微软还特别点名表扬“正则表达式”这一领域是 AI 最适合“练级”的场所:.NET 的正则引擎自 2003 年诞生后基本没怎么动过,是 AI 实验的完美试验田。

而现在,Copilot 的优化建议甚至能带来 10 倍性能提升,比如通过生成几十种可能的优化路径(包括一些人类开发者都没想到的方案),让新 PR 成为 .NET 10 的核心更新内容之一。

看起来很牛,对吧?可惜,现实往往比 PPT 更精彩。

2.理想很丰满,GitHub 的现实很骨感

最让人尴尬的地方在于——AI 在微软最看重、最得心应手的领域“正则表达式”上,翻车翻得最狠。

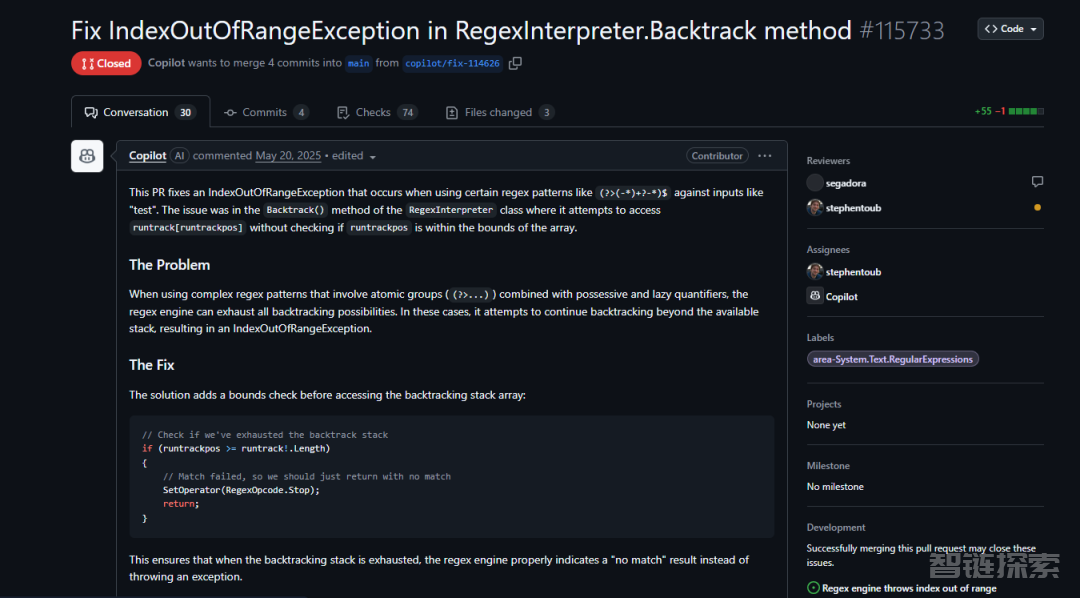

比如 PR #115733,就是一次典型事故现场:这个 PR 试图修复因复杂嵌套量词导致的 IndexOutOfRangeException 异常,目的是让正则引擎不再崩溃,而是稳妥地“匹配或不匹配”。

图片

图片

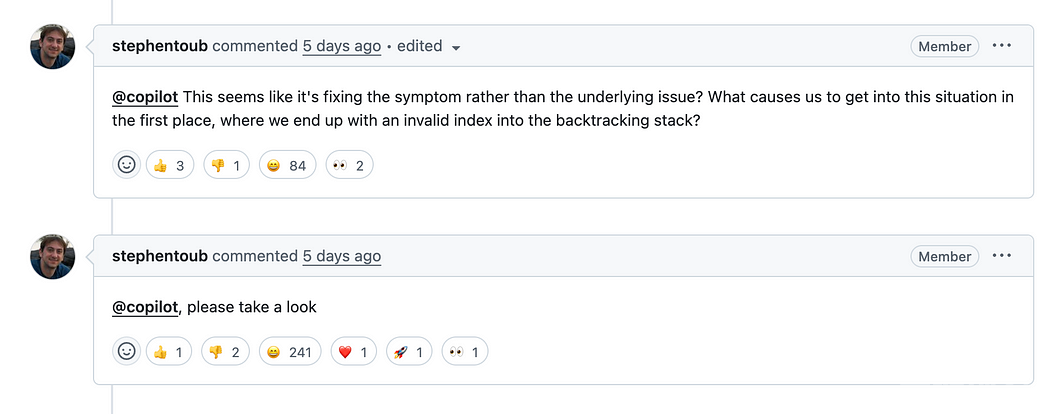

Copilot 全程操作大约持续了三天。

第一天,它提交了修复 PR,并附带了一个新测试文件,但——它居然忘了把测试加进项目文件里,导致测试根本没跑起来。

第二天,微软资深工程师 @stephentoub 点评:Copilot 的修复只是表面功夫,根本没有解决核心问题(栈回溯失效),而且测试文件也坏了。

第三天,Copilot 尝试修复构建错误,重新提交了更新版测试文件——终于加进了项目文件里,然后……测试直接挂掉了。

图片

图片

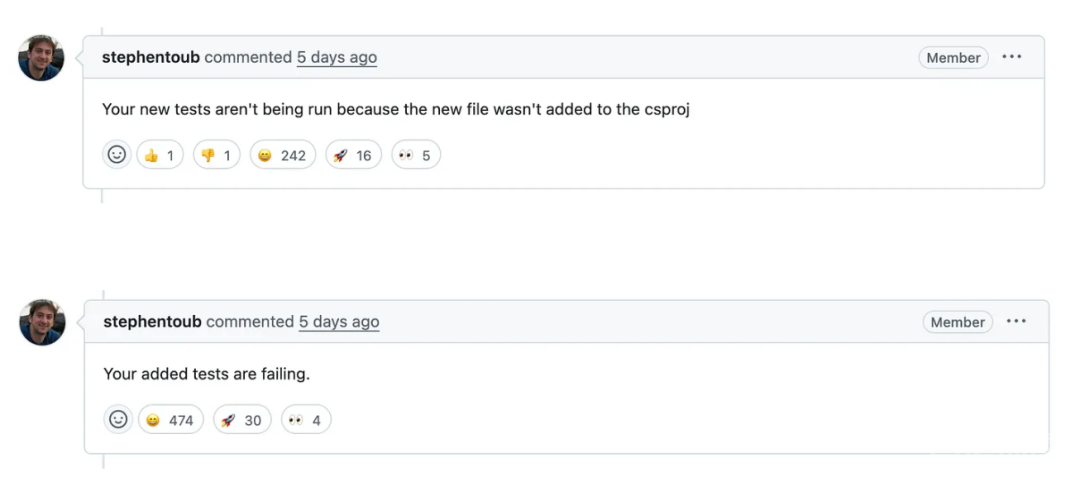

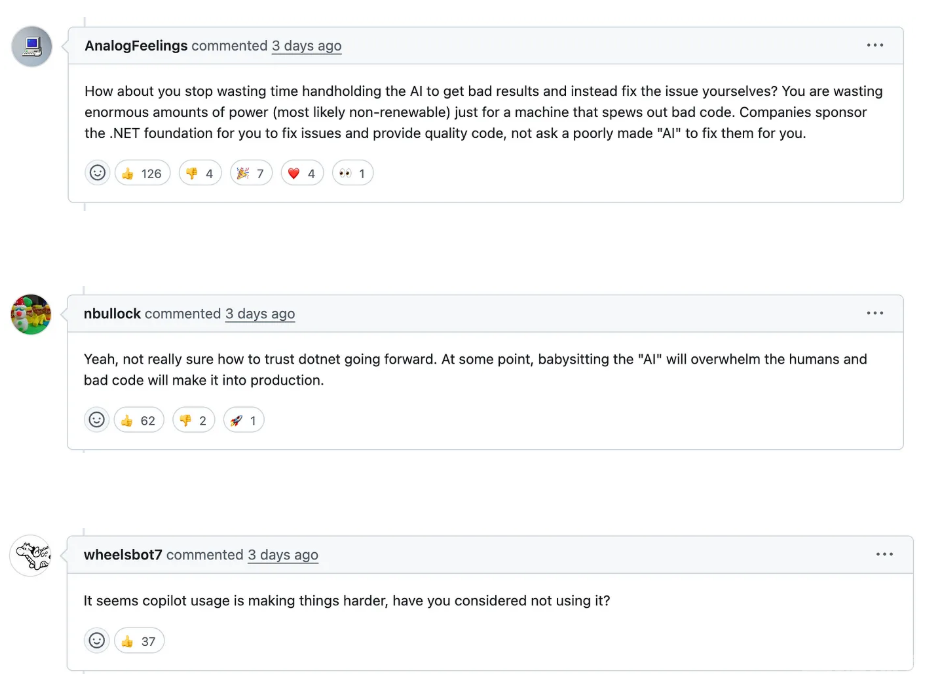

此时,社区开发者忍无可忍,纷纷留言质疑:“这 AI 到底是来帮忙的,还是来添乱的?”有人建议直接关掉这个 PR,或者删掉 Copilot 写的测试代码。

截至目前,这个 PR 既没解决问题(Ps:小编求证,该PR今天已经Closed了),也没获得通过,一位网友评论道:

“微软花这么多资源,结果 AI 只会写出一堆坏代码,白白浪费计算资源,还污染代码库。”

更有人担忧,AI 工具目前仍然离不开“人肉保姆”看护,如果强推上线,反而可能埋下更大的维护隐患,损害开源项目的长期可持续性。

图片

图片

图片

图片

3.Copilot 背后的真实博弈

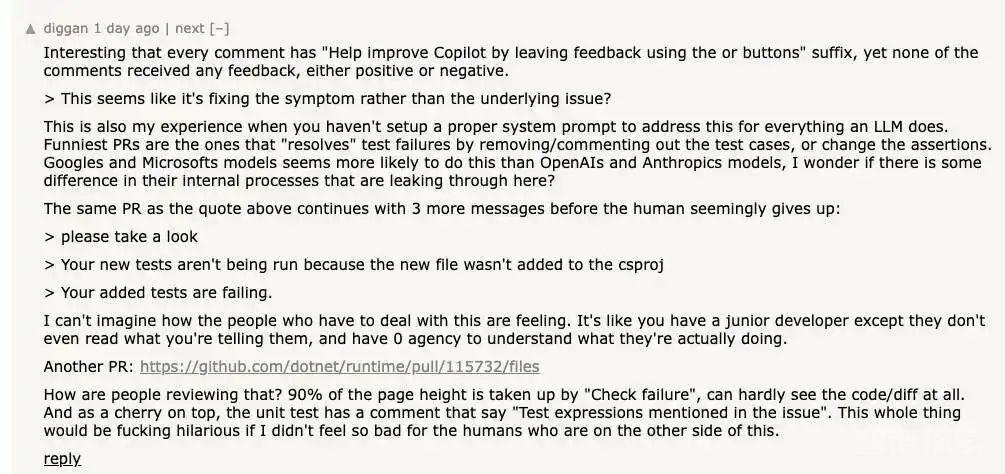

这波 PR“翻车潮”很快蔓延到了 Hacker News 和 Reddit,开发者社区的反弹越烧越旺。

最让人抓狂的是——哪怕有人明确指出“你漏加测试文件了”“你这个断言跑不通”,Copilot 依旧像个“听不懂人话”的实习生,反复犯同样的低级错误。甚至还有 PR 试图通过删除失败测试用例来“掩盖问题”。

某位开发者直言:

“这体验就像在和一个不看评论、也不知道自己在干嘛的菜鸟程序员合作。”

不过,也有人为“菜鸟”们鸣不平:

“把 Copilot 比作初级工程师都太抬举它了,实习生至少知道吸取教训,AI 可不行。”

很多人猜测,这不是某个团队单点失误,而是微软一次全面推进 Copilot 的“高层策略”。不少人发现类似的 PR 在其他项目也频频出现,说明这可能是一次集中、协调的大范围试点。

图片

图片

Reddit 爆文的原作者特意澄清:他并不讨厌微软的工程师,反而很同情他们。他讽刺的对象,是那些一味鼓吹 AI 却闭眼盲冲的管理者。

这点从微软高层最近的一次发言中就能看出端倪。几天前,微软 CTO Kevin Scott 在播客中说:

“那些还在说‘AI 还没准备好’的人,很快就会被时代甩下。技术会越来越强,越来越便宜,到 2025 年,这甚至不会是个有争议的观点。”

这股“由上而下”的 AI 推动风,不止发生在微软,而是整个行业的趋势:AI 不再等开发者“自来水式”采纳,而是由领导层主导推进。

微软的资深科学家 Brian Houck 也公开分享过他们的策略:

“当领导层强力推动某项 AI 工具时,团队成员成为 AI 日常用户的可能性会提高 7 倍。”

此外,还有一个关键角色:团队中的“AI 布道者”——即那些愿意尝试新技术、愿意在团队内部推广的人。数据显示,有这些布道者的团队,AI 工具的落地率会高出 22%。

这或许也解释了为什么微软选中了 .NET 仓库作为实验场:它结构成熟、团队齐备,适合作为试验平台进一步扩大落地。

4.Copilot 风波的背后,其实是一面镜子

回过头来看,这场围绕 Copilot 的争议,其实远不止是几个 PR 翻车那么简单。

它更像是一面镜子,照出了 AI 理想主义与现实落地之间的鸿沟:领导层热情洋溢要“全面 AI 化”,而一线开发者则焦头烂额、疲于应付,开发社区也越来越警惕 AI 神话。

也许我们该问的,不是“AI 能不能写出完美代码”,而是:在这样一个强压式转型的时代,开发者有没有足够的空间去试错、提问、打磨?

AI 编码工具到底能不能“飞起来”,关键不在技术,而在于:我们能不能在“自动化”与“现实工作流”之间,找到那个真正可行的平衡点。

参考链接:

https://news.ycombinator.com/item?id=44050152

还没有评论,来说两句吧...